Theo GizmoChina, việc sử dụng trí tuệ nhân tạo (AI) trong ngành công nghệ ngày càng phổ biến khi có ngày càng nhiều công ty tích hợp công nghệ này vào các dịch vụ của mình. Trong lĩnh vực này, Microsoft là một trong những công ty hàng đầu, luôn đặt ra nhiều mục tiêu để cải thiện trải nghiệm người dùng thông qua các công nghệ AI do chính họ tạo ra.

Tuy nhiên, trí tuệ nhân tạo vẫn được coi là một con dao hai lưỡi, vì việc sử dụng sai mục đích có thể gây ra những vấn đề nghiêm trọng. Và Microsoft đang đối mặt với thách thức khi một công cụ trí tuệ nhân tạo ban đầu được sử dụng để tạo ra hình ảnh đã bị lạm dụng để tạo ra nội dung không phù hợp liên quan đến người nổi tiếng.

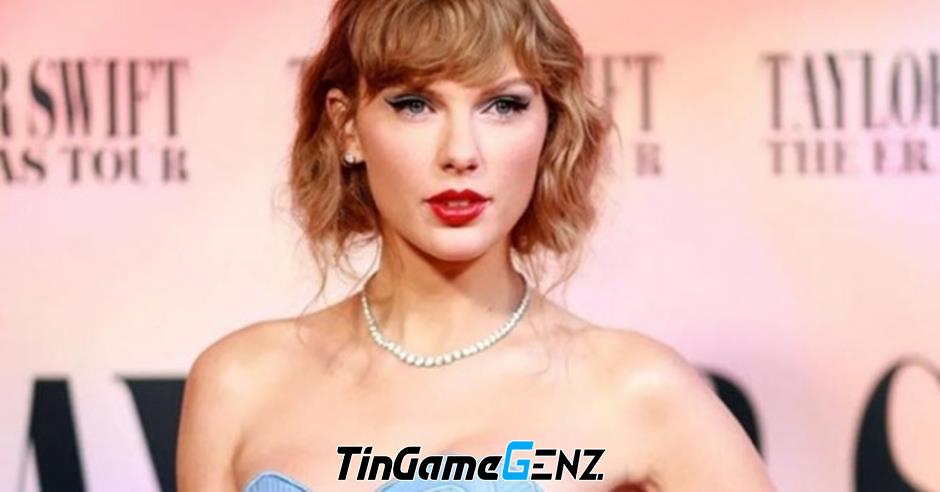

Cụ thể, nhờ vào Trí tuệ nhân tạo (AI), người sử dụng có thể tạo ra bất kỳ bức ảnh nào mà họ muốn, ngay cả khi không có kỹ năng chuyên gia về Photoshop. Sử dụng lợi thế này, một số người dùng đã có hành vi không đúng đắn bằng cách lợi dụng API Azure Face của Microsoft để tạo ra ảnh và video khỏa thân của những người nổi tiếng, trong đó phổ biến nhất là Taylor Swift. Đối diện với làn sóng độc hại này, Microsoft đã thông báo rằng họ đã vá lỗ hổng bảo mật để ngăn chặn việc tạo ra những hình ảnh có nội dung không tốt.

Cụ thể, công ty đã phát hiện ra một lỗ hổng bảo mật có thể cho phép những kẻ xấu can thiệp vào một số tham số API cụ thể, từ đó thay đổi hình ảnh khỏa thân bằng khuôn mặt của Taylor Swift. Để khắc phục tình huống này, Microsoft đã phát hành một bản cập nhật nhằm ngăn chặn việc sử dụng các tham số không hợp lệ trong API.

Các hình ảnh và video bị chỉnh sửa này thường được sử dụng để lan truyền tin tức giả mạo hoặc thực hiện các chiến dịch phỉ báng. Và Taylor Swift luôn là người bị tổn thương bởi hành vi lạm dụng đó.

Ngoài Microsoft, các công ty công nghệ khác cũng đang tích cực nỗ lực để giải quyết vấn đề này. Ví dụ, mạng xã hội X của Elon Musk đã hạn chế người dùng tìm kiếm về Taylor Swift nhằm ngăn chặn sự lan truyền của các video deepfake.