Sự phát triển của trí tuệ nhân tạo ngày càng tiên tiến và dễ tiếp cận đã gây nên nhiều tác động tiêu cực, đặc biệt là việc xuất hiện ngày càng nhiều hình ảnh giả mạo trên các mạng xã hội. Những hình ảnh này có thể được sử dụng để lan truyền thông tin sai lệch, gây tổn hại đến danh tiếng của một cá nhân hoặc thậm chí để lừa đảo người dùng.

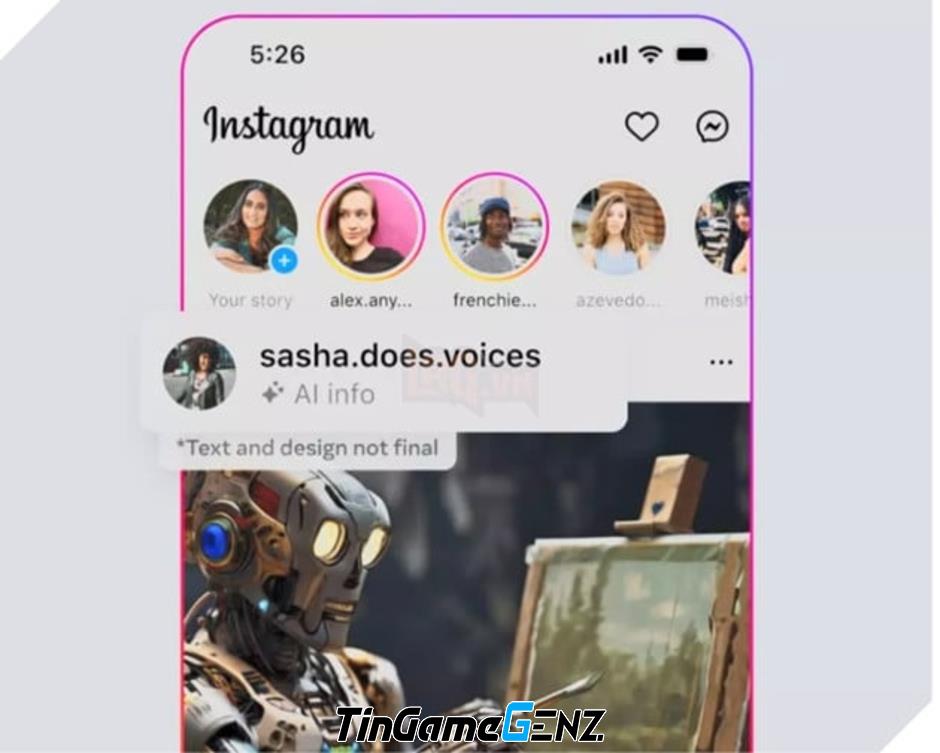

Để giải quyết vấn đề này, Meta đã đưa ra một kế hoạch mới để phát hiện và đánh dấu các hình ảnh AI được đăng tải trên các nền tảng của mình, bao gồm Facebook, Instagram và Threads. Việc đánh dấu này sẽ giúp người dùng nhận ra được hình ảnh nào là do AI tạo ra và từ đó có thể cảnh giác trước những thông tin sai lệch tiềm ẩn.

Chủ tịch phụ trách các vấn đề toàn cầu của Meta, Nick Clegg, đã thông báo rằng Meta sẽ đính kèm nhãn "Được tưởng tượng bằng AI" cho các hình ảnh được tạo bởi công cụ AI, nhằm giúp người dùng phân biệt được hình ảnh thật và hình ảnh được tạo bởi AI.

Sau khi hệ thống mới được thiết lập và hoạt động, Meta sẽ tiếp tục gắn nhãn các hình ảnh được tạo ra trên các dịch vụ của OpenAI, Microsoft, Adobe, Midjourney, Shutterstock và Google của Alphabet.

Meta hiện đang phát triển khả năng nhận diện hình ảnh được tạo bởi trí tuệ nhân tạo và sẽ bắt đầu gắn nhãn bằng tất cả các ngôn ngữ trên các ứng dụng của mình trong thời gian tới.

Clegg cho biết việc xác định nội dung âm thanh và video do trí tuệ nhân tạo (AI) tạo ra ngày càng khó khăn hơn do các công cụ ngày càng trở nên tinh vi. Tuy nhiên, Meta đang bổ sung một tính năng mới cho phép người dùng khai báo các nội dung video hoặc âm thanh do AI tạo ra để công ty có thể thêm nhãn vào chúng.

Bên cạnh cho phép người dùng tự tạo video và âm thanh AI, Meta cũng có thể áp dụng hình phạt đối với những người dùng cố tình tạo nội dung deepfake mà không báo cáo.

Clegg cũng cho biết nếu Meta phát hiện ra rằng một số hình ảnh, video hoặc nội dung âm thanh được tạo hoặc chỉnh sửa bởi trí tuệ nhân tạo có khả năng lừa dối công chúng, đặc biệt là về các vấn đề quan trọng, thì Meta có thể đặt nhãn nổi bật hơn nếu thấy thích hợp.

Không chỉ có Meta, nhiều công ty trong ngành đang cố gắng tìm cách xác định các nội dung gây hiểu lầm do trí tuệ nhân tạo (AI) tạo ra trong thời gian gần đến cuộc bầu cử. Vào tháng 9, Microsoft đã cảnh báo về việc hình ảnh AI từ Trung Quốc đang được sử dụng để ảnh hưởng đến quyết định của cử tri Mỹ.

Gần đây, có nhiều người dân ở New Hampshire đã nhận được cuộc gọi tự động kéo dài 39 giây, giả dạng Tổng thống Biden và yêu cầu họ không bỏ phiếu. Theo các chuyên gia, cuộc gọi giả mạo này được tạo ra bằng công cụ chuyển văn bản thành giọng nói do ElevenLabs phát triển, điều này đã dẫn đến việc Ủy ban Truyền thông Liên bang (FCC) đưa ra quyết định cấm sử dụng công nghệ giọng nói trí tuệ nhân tạo trong các cuộc gọi tự động.